قدس آنلاین:کم کم وقتش رسیده که «فتوشاپ» را فراموش کنیم. البته آنهایی که خدای ناکرده در کار تولید تصاویر جعلی هستند و یا در فضای مجازی قصد سر به سر گذاشتن با مخاطبان را دارند و میخواهند آبروی کسی را ببرند، مدتهاست «فتوشاپ» را کنار گذاشته و سراغ فناوریهای تازه رفتهاند. این ما هستیم که هنوز در شوخیها و تصوراتمان وقتی قرار است از قلابی بودن یک تصویر حرف بزنیم، واژه فتوشاپ را به کار میبریم. این روزها نه فقط اهالی جعل و جاعلی بلکه متخصصان، درباره «دیپ فیک» حرف میزنند و حتی از خطراتش میگویند که به قول بعضیها کمتر از خطر بمب اتمی نیست!

به چشمانتان اعتماد نکنید

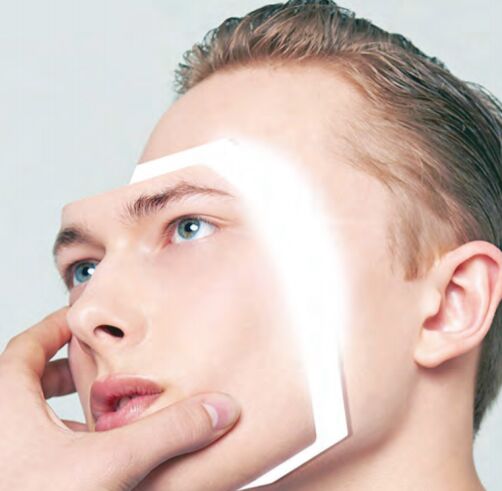

چند سالی است که شاهد ظهور فناوریهای هوشمند وخطرناکی به نام «دیپ فیک» هستیم که خیلی بیشتر از فتوشاپ، قدرت گول زدن مخاطبان، بهخصوص کاربران فضای مجازی را دارد. در فتوشاپ اگر فقط چشم بیننده یک تصویر گول میخورد، با «دیپ فیک» اما میشود چشم و گوش و عقل و هوش مخاطب را گول زد. سادهتر اینکه برای مقایسه سطح تواناییهای این دو فناوری، شما میتوانید فتوشاپ را چرتکه فرض کنید. در این حالت «دیپ فیک» چیزی است در حد یک ماشین حساب بسیار پیشرفته که میتواند معادلات پیچیده ریاضی را هم برای شما حل کرده و تانژانت و کتانژانت و رادیکال و... را حساب کند! بگذارید تعریف علمی اما سادهتر این جعل دقیق و عمیق را از قول اهل فن بنویسیم تا بدانید با چه پدیده پیشرفته اما خطرناکی روبهرو هستید.

دیپ فیک از دو عبارت «دیپ لرنینگ» و«فیک» تشکیل شده است. دراین تکنولوژی یک هوش مصنوعی نرمافزاری با کمک الگوریتمهای ترکیبی پردازش صدا و تصویر، ویدئویی را تولید میکند. هوش مصنوعی میتواند صورت یک سوژه (فرد اصلی) را روی چهره سوژهای دیگر (فرد هدف) کپی کند. در حالت پیشرفتهتر، این تکنولوژی میتواند یک مدل جدید بر اساس حرکات صورت شخص اصلی درست کرده و آن را روی شخص هدف قرار دهد. این یعنی اگر این تیغ دودَم، دست آدم نااهلی بیفتد (که افتاده) شما دیگر حتی به چشم خودتان هم نباید اعتماد کنید!

پیدایش

کمتر از یک ماه پیش اگر یادتان باشد خبری با این مضمون در خبرگزاریها منتشر شد: «تصاویر برهنه جعلی بیش از ۱۰۰ هزار زن در فضای مجازی انتشار یافته است. این تصاویر با سوءاستفاده از عکسهای منتشر شده کاربران در شبکههای اجتماعی ایجاد شده است... گفته میشود تصاویر کاربران با استفاده از هوش مصنوعی مخصوص دستکاری و سپس لباس آنها حذف و در تلگرام منتشر میشود». اما این خبر نقطه پیدایش «دیپ فیک» نیست. یعنی اگر ردّ این فناوری را بزنید به عالم سینما و بازیگری میرسید. نخستین بار به سر یک آدم علاقهمند به سینما (اما احتمالاً مریض) زد که از این فناوری، استفاده خلاف و ناجور کند. اوایل سال 2017 میلادی یک کاربر سایت «ردیت» ویدئوهای ناجوری از حضور بازیگران مطرح سینما در فیلمهای «پورن» را به اشتراک گذاشت. فیلمهایی که درواقع با بعضی از نرمافزارهای دم دستی ساخته شده و باوجود جعلی بودن کاملاً واقعی و قانعکننده به نظرمیرسید. یعنی تصاویر و ویدئوهایی از آن هنرپیشه از اینترنت جمعآوری شده و سپس همه تصاویر با فرایندی با عنوان «یادگیری عمیق» با استفاده از یک شبکه عصبی مصنوعی و الگوریتمی که دقیقاً با چهره آن بازیگرمطابقت داشت، رویهم سوار شده بود و به این ترتیب چهره بازیگر موجه و آبرومند سینما روی چهره یکی از بازیگران فیلمهای مستهجن قرار گرفته بود. شاید الان فکر کنید با فرایندی خیلی پیچیده و فنی روبهرو شدهایم اما واقعیت این است که این آقای کاربر با نام کاربری «دیپ فیک» به رایانهاش یاد داد چطور میشود با جمعآوری عکس و فیلمهای مختلف از بازیگران، چهره آنها را تکرار کرده و این تصاویر تکرار شده را روی چهره یک فرد دیگر در فیلمی دیگر سوار کرد. همه خطرناکی «دیپ فیک» این است که در یک فرایند تقریباً ساده شکل میگیرد، به سختافزار خاصی نیاز ندارد و میتواند توسط هر کس بدون نیاز به دانش برنامهنویسی انجام شود. پس از این ماجرا بود که سروکله نرمافزاری به نام «دیپ اَپ» هم در اینترنت پیدا شد که به همه کاربران اجازه میداد بدون نیاز به ابزارخاصی، فیلم جعلی مورد نظر خودشان را تولید کنند.

بینظیر اما ترسناک

البته آنچه بالاتر گفتیم، نقش و اثر منفی این فناوری بود وگرنه شاید شما هم تا همین جای مطلب به ذهنتان رسیده باشد که با استفاده درست از «دیپ فیک» در سینما میتوان اتفاقات بسیار خوبی را رقم زد. مثلاً کاری را که گروه جلوههای بصری یک پروژه سینمایی با صرف هزینه بسیار بالا در طول چند ماه انجام میدهند با این فناوری میتوان در یک روز و بدون هزینه انجام داد. برای درک فرصتهای بینظیری که دیپ فیک میتواند در اختیار صنعت فیلمسازی قرار دهد، تصور کنید فیلمی با یک بازیگر ناشناخته ساخته میشود و شما میتوانید در حین تماشا آن را با هر ستارهای که دوست دارید جایگزین کنید یا حتی اگر دوست داشته باشید خودتان ستاره فیلم باشید. بنابراین شما میتوانید بدون هزینههای سرسامآور، بسیاری از ستارگان سینما را از جهان مردگان برگردانید و دوباره در فیلمهای محبوبتان به تماشای آنها بنشینید.

آینده دیپ فیک هم هیجانانگیز و هم ترسناک است.اگر بشر بخواهد از آن بهعنوان ابزاری برای تخریب سیاسی و گمراه کردن افکار عمومی استفاده کند، بهزودی محدود شده و به تاریخ میپیوندد. اما اگر بخواهد از آن در هنرهای تجسمی استفاده کند، تجربههای بینظیری خلق خواهد شد.

در حال حاضر خود آمریکایی هم بیشتر از مایی که ممکن است تا امروز عنوان «دیپ فیک» به گوشمان نخورده باشد درباره خطرات این تکنولوژی سروصدا میکنند. مثلاً نماینده حزب جمهوریخواه آمریکا چند سال پیش قدرت فناوری دیپ فیک را با سلاح هستهای مقایسه کرد و گفت: «اگر کسی میخواست در گذشته آمریکا را تهدید کند تنها به چند سلاح هستهای و موشک نیاز داشت. امروزه تنها کافی است کشوری به سیستم اینترنتی آمریکا دسترسی پیدا کند. تنها چیزی که برای آسیب زدن به ما نیاز دارد، امکان تولید محتواهای غیرواقعی و ویدئوهای تقلبی بسیار واقعگرایانه است». البته آقای نماینده کمی هم غلو و مظلومنمایی کرده است. چون جاعلان اینترنتی و طرفداران این فناوری در بدترین حالت ممکن، دنبال بی آبرو کردن افراد خاص یا باج گرفتن از آنها هستند و هیچوقت علیه منافع سیاسی و اقتصادی یک کشور فعالیت نمیکنند در حالی که سازمانهایی مانند «سیا» هستند که میتوانند از این ترفند برای گول زدن مردم کشورهای مختلف، به راه انداختن نارضایتی عمومی و شورش، براندازی و... استفاده کنند.

کمی تأمل کنید

میتوان گفت تشخیص ویدئوهای دیپ فیک که با کیفیت بالا طراحی شدهاند بسیار دشوار است. از طرف دیگر ویدئوهای دیپ فیک که توسط کاربران و با برنامههای اینترنتی ساخته میشوند به راحتی قابل تشخیص هستند چرا که زمان زیادی صرف ساخت آنها نمیشود. اما ویدئوهایی که توسط فرآاند «گَن» تولید میشود از کیفیت و دقت برخوردارند و بیشتر مواقع کاربران برای تشخیص آنها نیاز به یک هوش مصنوعی دیگر دارند. در حال حاضر شرکتهای تحقیقاتی بسیاری سعی دارند روشهای قابل اعتمادتری را برای تشخیص ویدئوهای دیپ فیک قوی پیدا کنند.

باشگاه خبرنگاران جوان، دیروز در گزارشی نوشت: «در حالی که فناوری دیپ فیک پیش از این تنها در دستان سازمانهای بزرگ مانند «سیا» بود اما امروزه هر کاربری میتواند با دانلود برنامههای تولید ویدئوی دیپ فیک به این فناوری دست پیدا کرده و از آن برای اهداف غیراخلاقی استفاده کند. خوشبختانه تا امروز نمونه دیپ فیک قرار گرفته در دست کاربران از کیفیت بالایی برخوردار نبوده و از این رو تشخیص آنها ساده است».

مشکل اما اینجاست که در بسیاری از کشورها و از جمله کشور خودمان، همه کاربران فضای مجازی، سواد رسانهای بالا ندارند و از ترفندهای مختلف صوتی و تصویری مثل «دیپ فیک» با خبر نیستند در نتیجه هر فیلمی که با این تکنولوژی تولید و منتشر شده بهراحتی میتواند آنها را گول بزند و ماجرایی را که وجود نداشته به عنوان یک واقعیت در جهان انتشار دهد. در این حالت آبروی افراد چه در عالم سیاست، چه در اجتماع و چه در زندگی خصوصی همواره بازیچه دست جاعلهایی است که برای اهداف زشت خود از این ترفند استفاده میکنند. پس اگر در اینترنت ویدئویی را از یک شخصیت معروف دیدید که حرفهای عجیب و غیرمعقول میزند، رفتار غیرقابل باور از او سر میزند، در محافل و یا موقعیتهای خاص دیده میشود و... به جای متأثر شدن فوری، کمی تأمل کرده و احتمال بدهید شاید با یک دیپ فیک سروکار دارید.

نظر شما