حوالی امروز/ مثلاً اولین مشاهده یا برخورد خودتان با «چت جیپیتی» را در نظر بگیرید و اینکه هوش مصنوعی مقابلتان، در مدتی که با اوگپ زدهاید (یا در فیلمی دیدهاید که کسی با او حرف میزند) چقدر با حرفها و پاسخهایش شما را شگفتزده کرده است! چه متخصصان و چه سایر مردم، پس از برخورد با نمونههای پیشرفته هوشمصنوعی، با شگفتزدگی لب به تحسین بازکردهاند و در ادامه برخیها که کمی آیندهنگر، بدبین و حسابگر هستند، برای آینده انسان و اینکه مبادا روباتها درهمه چیز جایگزین آدمها شوند و ما را از صحنه حیات اجتماعی حذف کنند، ابراز نگرانی کردهاند. با این همه، هستند معدود افرادی که به رابطه انسان و هوش مصنوعی از زاویه آسیبشناسانه دیگری نگاه میکنند.

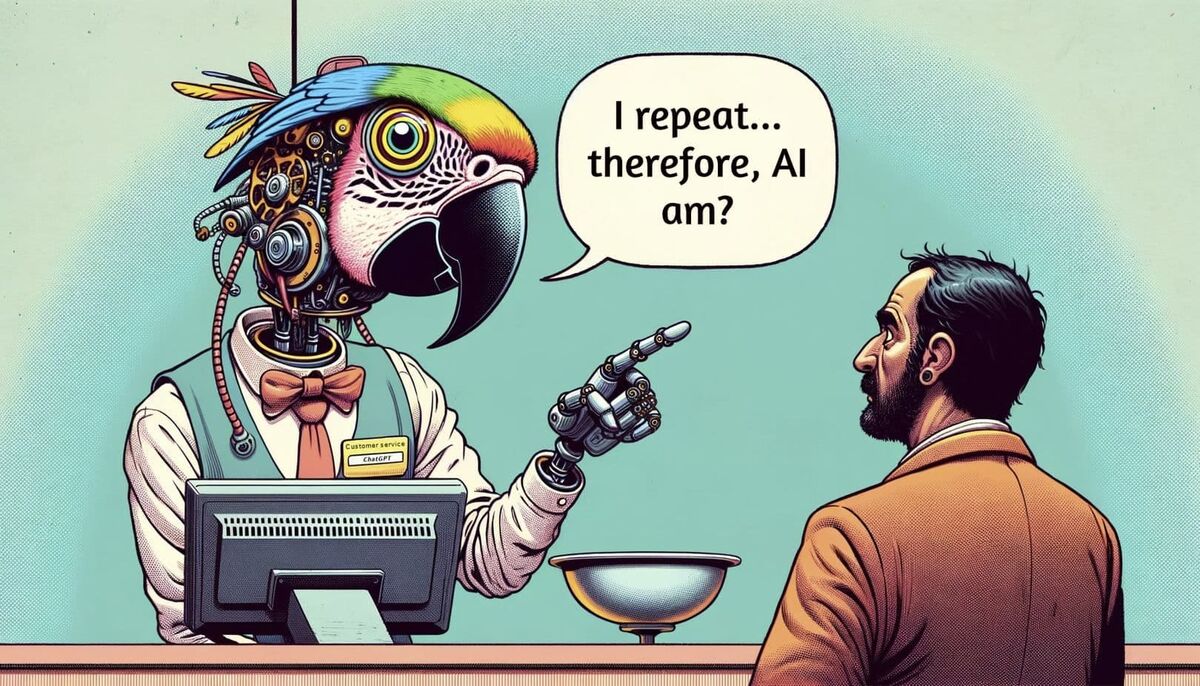

بهتازگی انگار «چت جیپیتی» و سایر هوش مصنوعیهای رقیبش، در اینکه بیشتر مثل آدمها حرف بزنند، با هم مسابقه گذاشتهاند! این مسابقه سبب شده زبانشناسان هم در تحقیقات مربوط به هوش مصنوعی و افزودن بر قابلیتهای آن نقشآفرین شوند. اما خانم «امیلی بِندِر» از آن زبانشناسهایی است که برخلاف خیلی از همکارانش، چندان موافق این ماجرا نیست و میخواهد یکتنه در مقابل این چشماندازِ فناورانه که پشتوانه تریلیون دلاری هم دارد، بایستد. انتقادهای او همراه با پرسشهای گزندهای است که اساس حرف زدن هوش مصنوعی را به چالش میکشد. مثلاً «چرا باید روباتها مثل انسانها حرف بزنند؟ به همزدن مرز میان انسان و روبات چه فایدهای برای بشریت دارد؟»

«الیزابت ویل» نویسنده «نیویورک مگزین» در مقالهای که ترجمه آن را سایت «ترجمان» منتشر کرده، به افکار و پرسشهای تفکربرانگیز خانم «بندر» پرداخته و یادآوری کرده حرفهای این زبانشناس مال امروز و دیروز نیست، بلکه سال ۲۰۲۰ که هنوزخبری از «چتجیپیتی» در مفهوم امروزیاش نبود، در مطلبی با عنوان «اختاپوس» درباره ناتوانیهای فناوری پشتیبان روباتهایی مثل چتجیپیتی صحبت کرده است. مثالی که این زبانشناس برای شناخت ناتوانیهای هوش مصنوعی میزند، جالب است: «فرض کنیم «الف» و «ب» که هر دو به زبان انگلیسی مسلط هستند، دور از هم، در دو جزیره خالی از سکنه گیر افتادهاند.

مشکل کجاست؟

نویسنده ماجرای اختاپوس (خانم بِنِدر) مدتی بعد درباره مشکلات هوش مصنوعی سخنگو و اینکه پویایی زبان را طی زمان از بین میبرد، مقاله «در باب مخاطرات طوطیهای الابختکی» را نوشت. او میگفت ما از اهالی حوزه هوش مصنوعی میخواهیم متوجه این موضوع باشند که توسعه برنامههایی که هدفشان تقلید باورپذیر از رفتار و گفتار انسان است، بدون توجه به ابعاد اخلاقی، آسیبهای جدی را به همراه دارند. چتباتهایی که ما بهراحتی آنها را با انسان اشتباه میگیریم، فقط بامزه یا اعصابخردکن نیستند؛ آنها دارند مرز انسان بودن و غیرانسان بودن را جابهجا میکنند. جابهجایی این مرز و مبهم کردن تفاوتهای انسان و غیرانسان، گسست اجتماعی و از هم پاشیدن جامعه را به دنبال دارد.

«الیزابت ویل» در نهایت معتقد است حرف اصلی داستان اختاپوس و منتقدان هوش مصنوعی، اصلاً درباره فناوری و ویژگیهایش نیست بلکه آنها درباره «خودِ ما» صحبت میکنند و معترضاند حالا با وجود این فناوریهای سخنگو، با خودمان چگونه رفتار میکنیم و چه بلایی سر هویت، شخصیت و رفتارمان میآوریم؟ ما دنیا را تغییر دادهایم، یاد گرفتهایم ماشینهایی بسازیم که بهطور مکانیکی متن تولید کنند و حرف بزنند اما هنوز یاد نگرفتهایم چطور میان ماشین و ذهن انسان تمایز قائل شویم!

نظر شما